C'est quoi un LLM?

Les Large Language Models expliqués simplement. Ce que c'est, comment ça marche, et ce que ça peut faire.

Quelqu'un commence une phrase: "Il était une..."

Tu penses immédiatement "fois".

Ou: "La capitale de la France est..."

Tu penses "Paris".

Ce réflexe de prédire la suite, c'est exactement ce que fait un LLM. Sauf qu'il le fait après avoir lu une bonne partie d'internet.

Un LLM, c'est quoi?

Un Large Language Model (LLM), c'est un programme entraîné sur une quantité massive de texte (livres, articles, code, forums) qui prédit le mot suivant dans une séquence.

Tu tapes "Le chat dort sur le..." et le modèle calcule les probabilités: "canapé" 23%, "toit" 18%, "lit" 12%... Il choisit un mot, l'ajoute à la séquence, et recommence. Mot après mot, il construit des réponses entières.

Tout ce qu'un LLM fait, résumer un document, écrire du code, répondre à une question, c'est de la prédiction de texte. La qualité vient du volume de données sur lequel il a été entraîné et de l'architecture qui lui permet de comprendre le contexte.

Comment ça marche

Ce qui rend les LLMs modernes puissants, c'est l'architecture Transformer (le "T" dans GPT).

Contrairement aux anciennes approches qui traitaient le texte mot par mot, les Transformers analysent tout le contexte en parallèle.

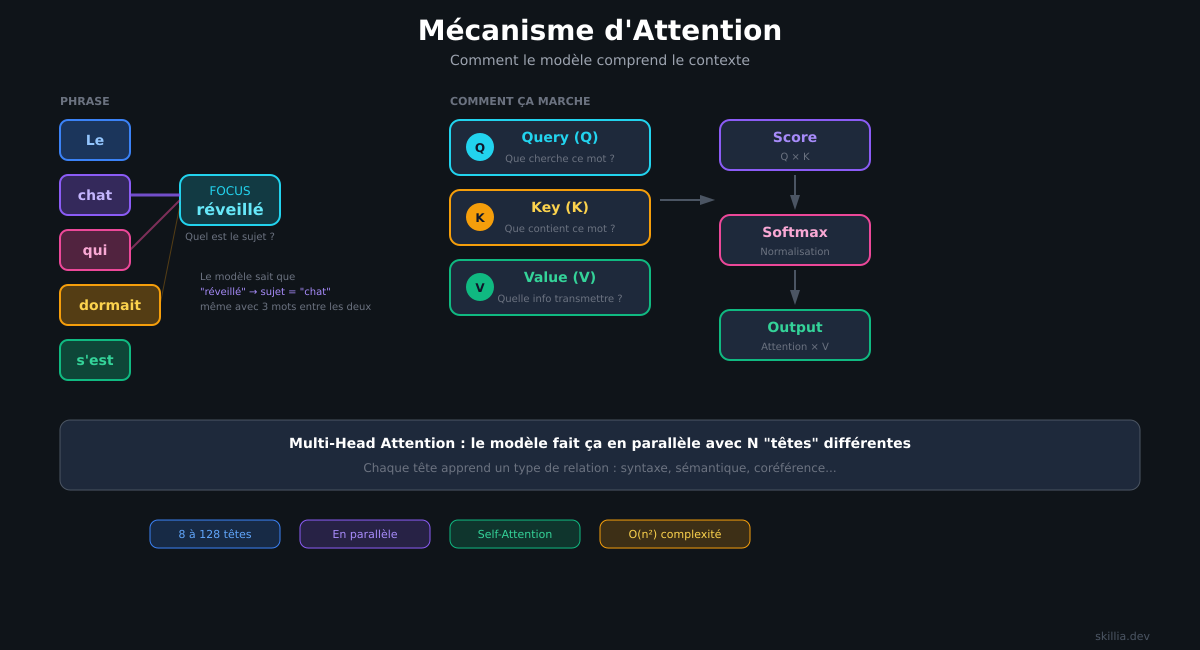

Le mécanisme clé s'appelle l'attention: pour chaque mot, le modèle évalue quels autres mots sont importants pour le comprendre.

Exemple avec "Le chat qui dormait sur le canapé s'est réveillé": pour comprendre "s'est réveillé", le modèle doit savoir que c'est "le chat" qui fait l'action. L'attention permet de faire ce lien, même si les mots sont éloignés dans la phrase.

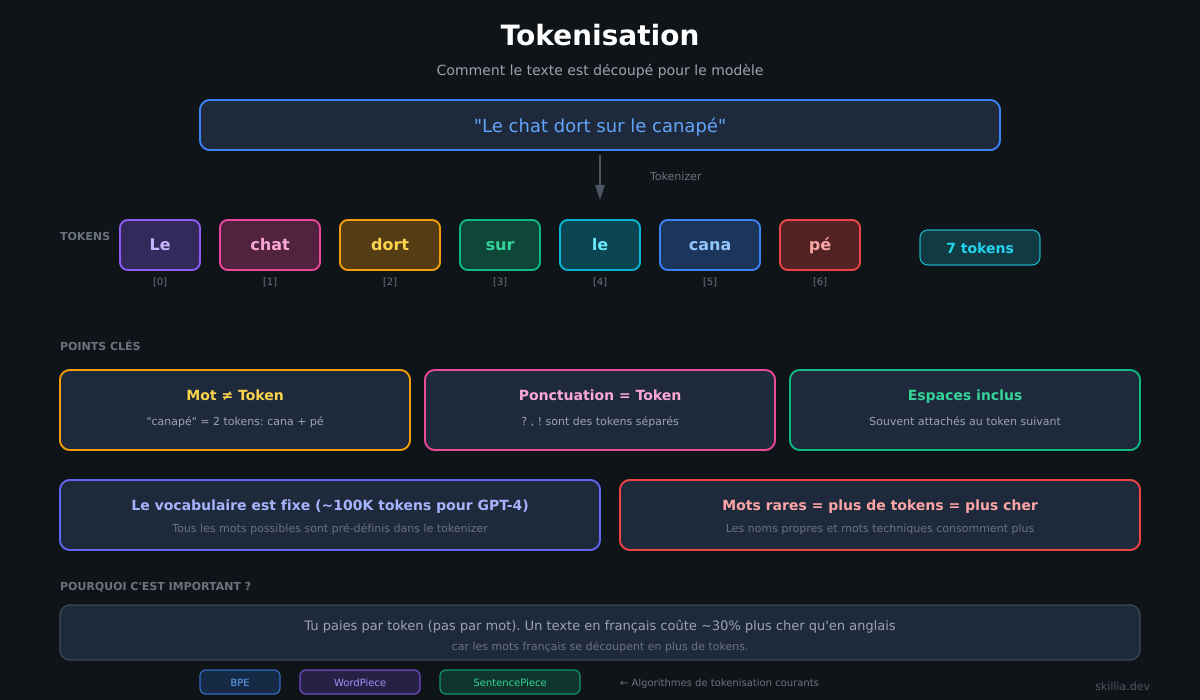

Le texte est découpé en petites unités appelées tokens. Un token peut être un mot entier, une partie de mot ou même un signe de ponctuation. Le modèle travaille avec ces tokens, pas avec des mots au sens classique.

Le pipeline complet

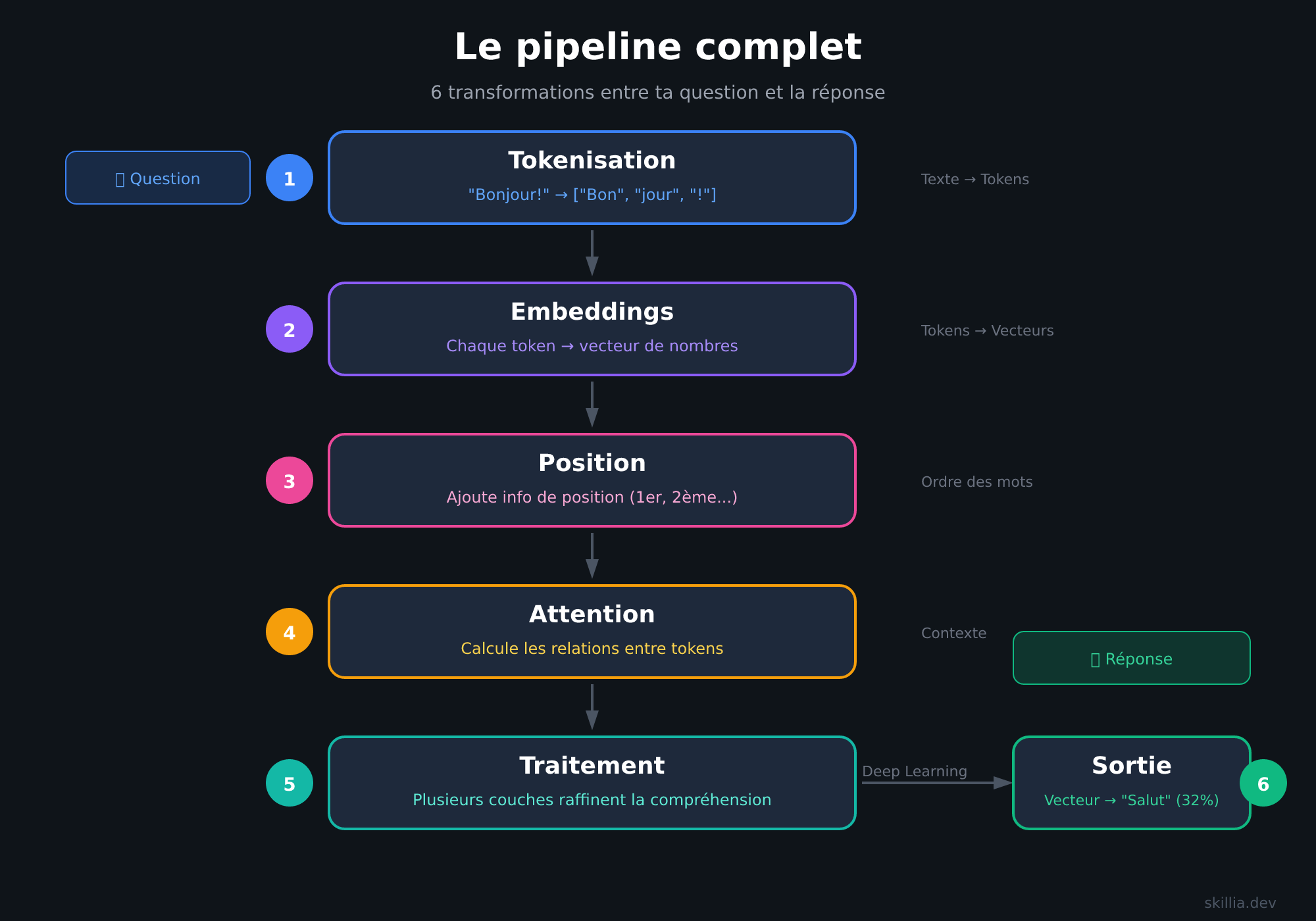

Entre ta question et la réponse du modèle, il y a 6 transformations.

"Bonjour!"

↓

[1. Tokenisation] → ["Bon", "jour", "!"]

↓

[2. Embeddings] → Chaque token devient un vecteur de nombres

↓

[3. Position] → Le modèle sait que "Bon" est en position 1

↓

[4. Attention] → Le modèle calcule les relations entre tokens

↓

[5. Traitement] → Plusieurs couches raffinent la compréhension

↓

[6. Sortie] → Le vecteur final devient des probabilités → "Salut" (32%), "Hey" (18%)...

Tokenisation: Le texte est découpé en tokens (mots ou morceaux de mots).

Embeddings: Chaque token devient un vecteur, une liste de 768 à 4096 nombres. Les mots similaires ont des vecteurs proches. C'est ce qui permet au modèle de comprendre que "chat" et "chien" sont liés.

Position: Le modèle ajoute l'information de position. Sans ça, "Le chat mange la souris" et "La souris mange le chat" seraient identiques.

Attention: Pour chaque token, le modèle calcule quels autres tokens sont importants. C'est le cœur du Transformer, ce qui lui permet de comprendre le contexte.

Traitement: Le signal passe par des dizaines de couches. Les premières captent la grammaire, les suivantes le sens, les dernières le raisonnement abstrait.

Sortie: Le vecteur final est comparé à tous les tokens possibles. Ça donne une probabilité pour chaque mot. Le modèle échantillonne parmi ces probabilités pour générer la réponse.

Ce cycle se répète pour chaque token généré. C'est pour ça que les réponses longues prennent plus de temps et coûtent plus cher.

Les paramètres de génération

Quand le modèle arrive à l'étape 6 (sortie), il a une liste de probabilités pour chaque mot possible. Mais comment choisit-il?

C'est là qu'interviennent les paramètres de génération. Tu les retrouves dans toutes les APIs (OpenAI, Anthropic, etc.).

Temperature — Le curseur créativité.

- 0 : Le modèle choisit toujours le mot le plus probable. Réponses identiques à chaque fois.

- 0.3 : Légère variation. Idéal pour du factuel (code, analyse).

- 0.7 : Équilibré. Le défaut de la plupart des APIs.

- 1.0+ : Plus de créativité, mais risque d'incohérence.

Top-p (nucleus sampling) — Limite les choix aux mots les plus probables.

Avec top_p=0.9, le modèle ne considère que les mots qui représentent 90% de la probabilité totale. Les mots improbables sont exclus.

Top-k — Encore plus strict.

Avec top_k=50, le modèle ne choisit que parmi les 50 mots les plus probables, peu importe leur probabilité combinée.

En pratique:

- Code, analyse, factuel →

temperature: 0.2-0.5 - Conversation, rédaction →

temperature: 0.7(défaut) - Créatif, brainstorming →

temperature: 0.9-1.0

La plupart du temps, tu n'as besoin de toucher qu'à la temperature. Top-p et top-k sont là pour les cas avancés.

Comment un LLM est construit

Un LLM ne naît pas intelligent. Il le devient en 4 étapes.

Étape 1: Le modèle brut. Au départ, le modèle ne sait rien. Tu lui demandes "C'est quoi un LLM?" et il te répond du charabia. Ses paramètres (les valeurs internes qu'il ajuste pour apprendre) sont aléatoires.

Étape 2: Le pre-training. On lui fait lire des milliards de pages de texte. Il apprend la grammaire, des faits sur le monde, des patterns de code. Après cette étape, il sait compléter du texte. Mais il ne sait pas avoir une conversation. Si tu lui poses une question, il va juste continuer ta phrase au lieu de te répondre.

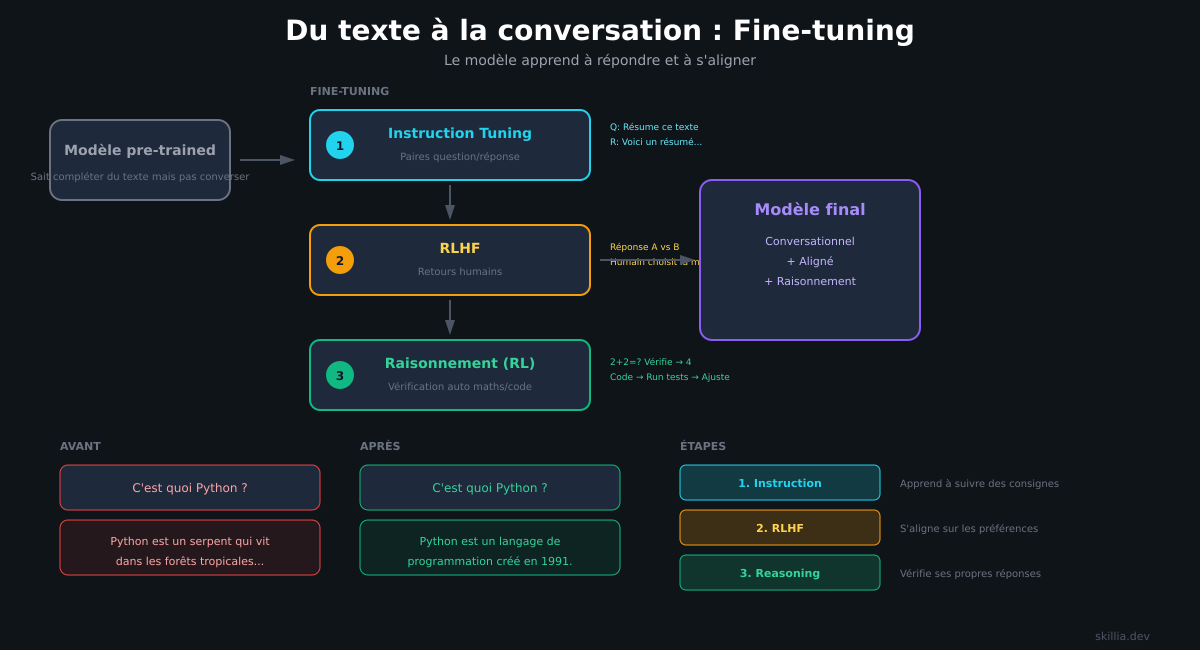

Étape 3: L'instruction fine-tuning. On l'entraîne sur des paires question/réponse pour lui apprendre à suivre des instructions. C'est à cette étape qu'il devient conversationnel. Il peut maintenant répondre à des questions, résumer du contenu, écrire du code.

Étape 4: Le fine-tuning par préférences et raisonnement. On utilise des retours humains pour affiner ses réponses. Tu sais quand ChatGPT te demande "Quelle réponse tu préfères?" Ce n'est pas juste pour le feedback, c'est de la donnée d'entraînement. Le modèle apprend à s'aligner avec ce que les humains attendent. Pour les tâches de raisonnement (maths, logique), on utilise la vérification automatique: le modèle génère une réponse, on compare avec la bonne, et il s'ajuste.

Ces 4 étapes transforment un programme aléatoire en outil capable de rédiger, analyser et raisonner.

Ce que ça peut faire

Un LLM génère du texte. Ça paraît simple, mais ça couvre beaucoup de choses.

Rédiger:

- Emails, rapports, documentation

- Code dans n'importe quel langage

- Traductions

Analyser:

- Résumer un document

- Extraire des informations clés

- Comparer des textes

Transformer:

- Reformuler un texte

- Changer le ton ou le style

- Convertir un format en un autre (JSON → CSV, etc.)

Raisonner:

- Répondre à des questions complexes

- Résoudre des problèmes étape par étape

- Debugger du code

Les limites

Les LLMs ne sont pas parfaits.

Hallucinations. Le modèle peut inventer des informations avec aplomb. Il génère ce qui est probable, pas ce qui est vrai. Toujours vérifier les faits importants.

Pas de mémoire. Chaque conversation repart de zéro. Le modèle ne se souvient pas de ce que tu lui as dit hier (sauf si tu utilises des techniques comme CLAUDE.md pour lui donner du contexte).

Context window limité. Le modèle ne peut traiter qu'une quantité limitée de texte à la fois. Plus la conversation est longue, plus la qualité peut se dégrader.

Coûts. Les modèles les plus puissants coûtent cher. Tu paies pour ce que tu envoies (ta question, ton contexte) et pour ce que le modèle génère (sa réponse). Exemple: Claude Opus 4.5 coûte $5 par million de tokens envoyés et $25 par million de tokens générés. Sur du volume, ça chiffre vite.

Ce qui a changé

Les LLMs d'il y a deux ans avaient des limites frustrantes. Ceux de 2026 sont nettement plus fiables.

Le changement principal: les reasoning models.

Au lieu de répondre directement, les nouveaux modèles "réfléchissent" étape par étape avant de donner une réponse. Résultat: moins d'erreurs sur les tâches complexes.

Claude Opus 4.5 résout 80.9% des vrais bugs de code sur SWE-bench. GPT-5.2 atteint 92.4% sur GPQA (benchmark de raisonnement scientifique). Gemini 3 Pro monte à 91.9% sur GPQA avec un context window d'1 million de tokens.

Les hallucinations sont moins fréquentes, le raisonnement est plus solide.

Quel modèle choisir?

Modèles payants (via API):

- Claude Opus 4.5 ($5/$25, 200K context) : #1 au classement Arena (1554). SWE-bench 80.9%, GPQA 87.0%. Le plus performant sur les tâches complexes et le coding.

- Gemini 3 Pro ($2/$12, 1M context) : #2 Arena (1519). GPQA 91.9%. Context window massif d'1 million de tokens pour analyser des documents entiers.

- GPT-5.2 ($1.75/$14, 400K context) : #3 Arena (1432). GPQA 92.4%, SWE-bench 80.0%. Meilleur rapport qualité/prix des modèles fermés. Sa variante Codex est optimisée pour le code.

- Gemini 3 Flash ($0.50/$3, 1M context) : #4 Arena (1357). GPQA 90.4%, SWE-bench 78.0%. Le meilleur rapport qualité/prix toutes catégories. Idéal pour le volume.

- Claude Sonnet 4.5 ($3/$15, 200K context) : Coding Arena 1203 (#1 en code). GPQA 83.4%. Suffisant pour 80% des cas d'usage.

Modèles open source:

- Kimi K2.5 (Moonshot) : $0.60/$2.50, 262K context. GPQA 87.6%, SWE-bench 76.8%. Open source et très compétitif pour le prix.

- GLM-4.7 (Zhipu AI) : $0.60/$2.20, 205K context. Coding Arena 1029, GPQA 85.7%. Un outsider chinois à surveiller.

- GLM-4.6 (Zhipu AI) : $0.55/$2.19, 131K context. SWE-bench 68.0%. Encore plus abordable.

- Llama 4 (Meta) : Context jusqu'à 10M tokens avec Scout. Licence permissive mais branding requis.

- DeepSeek R1 : Licence MIT, zéro restriction. Fort en raisonnement.

En pratique: Commence avec Claude Sonnet 4.5 ou GPT-5.2 pour tester. Passe sur Kimi K2.5 ou GLM quand tu as besoin de scaler ou de réduire les coûts.

Données: llm-stats.com — janvier 2026

Par où commencer?

-

Expérimente. Pose des questions, teste les limites. C'est le meilleur moyen de comprendre ce que le modèle peut et ne peut pas faire.

-

Sois précis. La qualité de tes résultats dépend de la qualité de tes instructions. Donne du contexte, explique ce que tu attends.

-

Vérifie. Ne fais jamais confiance aveuglément. Les LLMs sont des outils, pas des oracles.

-

Itère. Si le résultat n'est pas bon, reformule. Le prompting c'est une conversation, pas une commande unique.

En résumé

Un LLM, c'est un programme qui prédit le mot suivant après avoir lu des milliards de pages de texte. Il est construit en 4 étapes: pre-training, instruction, préférences humaines, et raisonnement.

En 2026, avec les reasoning models, c'est devenu un outil fiable pour rédiger, analyser, transformer et raisonner sur du texte.

C'est pas magique, c'est pas parfait, mais c'est suffisamment puissant pour changer ta façon de travailler.

Sources: