Pourquoi un proxy LLM

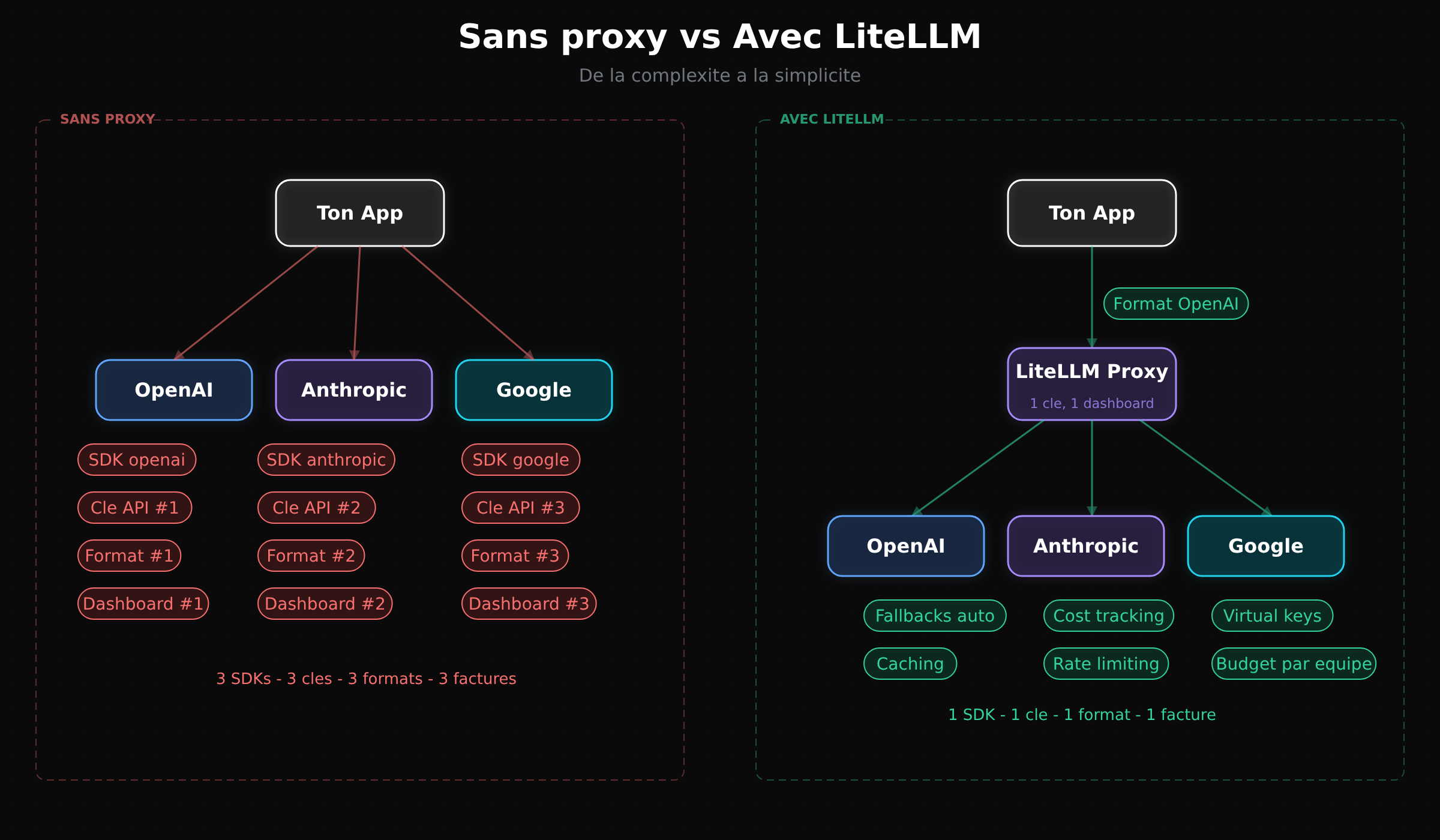

Tu paies Claude, GPT et Gemini séparément. Trois clés API, trois dashboards, trois formats de réponse. Tu veux tester un nouveau modèle ? Faut changer du code.

La solution : un proxy LLM qui unifie tout derrière une seule API. Ton app envoie ses requêtes au format OpenAI (/v1/chat/completions) -- devenu le standard de facto que tous les outils comprennent -- et le proxy traduit et route vers le bon provider. Tu changes de modèle en une ligne de config, pas une ligne de code.

Le problème concret

Kate Soule (IBM Research) résume bien :

"I've got 140,000 models to choose from, where do I start? Routing gives you the ability to finesse price and performance."

Sans proxy, chaque provider a son SDK, son format, son dashboard de facturation. Tu veux passer de Claude à GPT ? Tu changes l'import, le format des messages, la gestion d'erreurs. Multiplie ça par 3 providers et 5 projets.

Avec un proxy, toutes tes apps utilisent le même format de requête (celui d'OpenAI, devenu la norme universelle). Le proxy s'occupe de traduire et dispatcher vers Claude, GPT, Gemini ou un modèle open-source. Tu vois tous tes coûts au même endroit.

LiteLLM vs OpenRouter : complémentaires, pas concurrents

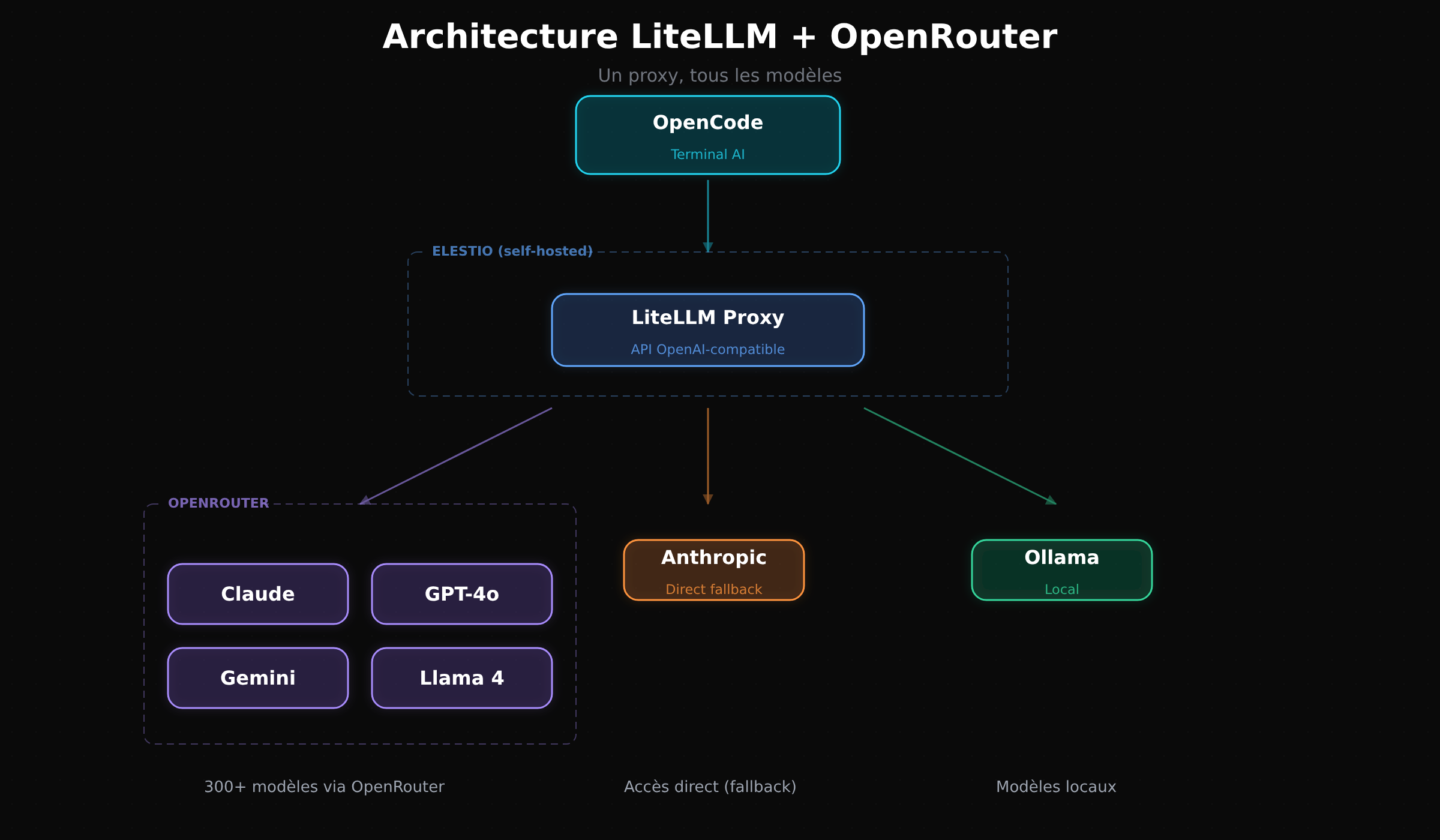

OpenRouter est un service managé. Tu crées un compte, tu récupères une clé API, et tu as accès à 300+ modèles via une API unique. Zéro infra à gérer. Simon Willison l'utilise pour son outil llm et note que "OpenRouter can route prompts to different providers depending on factors like latency, cost or as a fallback."

LiteLLM est un proxy open-source que tu héberges toi-même. Il expose une API OpenAI-compatible et route vers n'importe quel provider (y compris OpenRouter). L'avantage : tes requêtes ne passent pas par un intermédiaire, tu contrôles les virtual keys, les budgets par équipe, les fallbacks, et le cost tracking.

Denis Rasulev résume la dynamique :

"Teams often start with OpenRouter for rapid prototyping, then migrate to LiteLLM as their needs for control and customization grow."

Le combo LiteLLM + OpenRouter te donne le meilleur des deux : le contrôle du self-hosted avec l'accès universel aux modèles. LiteLLM utilise OpenRouter comme un provider parmi d'autres.

Dans la prochaine leçon, on déploie LiteLLM sur Elestio.