Déployer LiteLLM sur Elestio

LiteLLM est 100% open-source (MIT License). Tu peux l'héberger n'importe où : un VPS, un Raspberry Pi, ton propre serveur, un cluster Kubernetes. Si tu as Docker, tu peux le lancer gratuitement.

docker run -d -p 4000:4000 ghcr.io/berriai/litellm:main-latest

Mais gérer l'infra toi-même (SSL, backups, mises à jour, monitoring), ça prend du temps. C'est là qu'Elestio entre en jeu.

Pourquoi Elestio

Elestio est une plateforme de déploiement d'applications open-source. L'idée : tu choisis un logiciel dans le catalogue, tu sélectionnes ton cloud provider, et Elestio gère tout le reste.

Ce que tu obtiens en un clic :

- SSL automatique : certificat Let's Encrypt configuré et renouvelé sans intervention

- Backups quotidiens : snapshots automatiques de tes données

- Mises à jour : notifications et updates en un clic depuis le dashboard

- Monitoring : alertes CPU/RAM/disque intégrées

- Support : équipe réactive si tu as un problème

- Multi-cloud : tu choisis entre Hetzner, DigitalOcean, AWS, Vultr, et d'autres

En gros, tu gardes les avantages du self-hosted (contrôle total, pas de vendor lock-in) sans la charge ops.

Pricing

À partir de 14$/mois (support communautaire inclus). Tu choisis ton cloud provider et tes specs. Pour un proxy LiteLLM qui route des requêtes, le plan de base suffit largement.

Pour rappel : LiteLLM lui-même est gratuit. Les 14$/mois couvrent l'hébergement managé, le SSL, les backups, et le support.

Le process

- Crée un compte sur elest.io

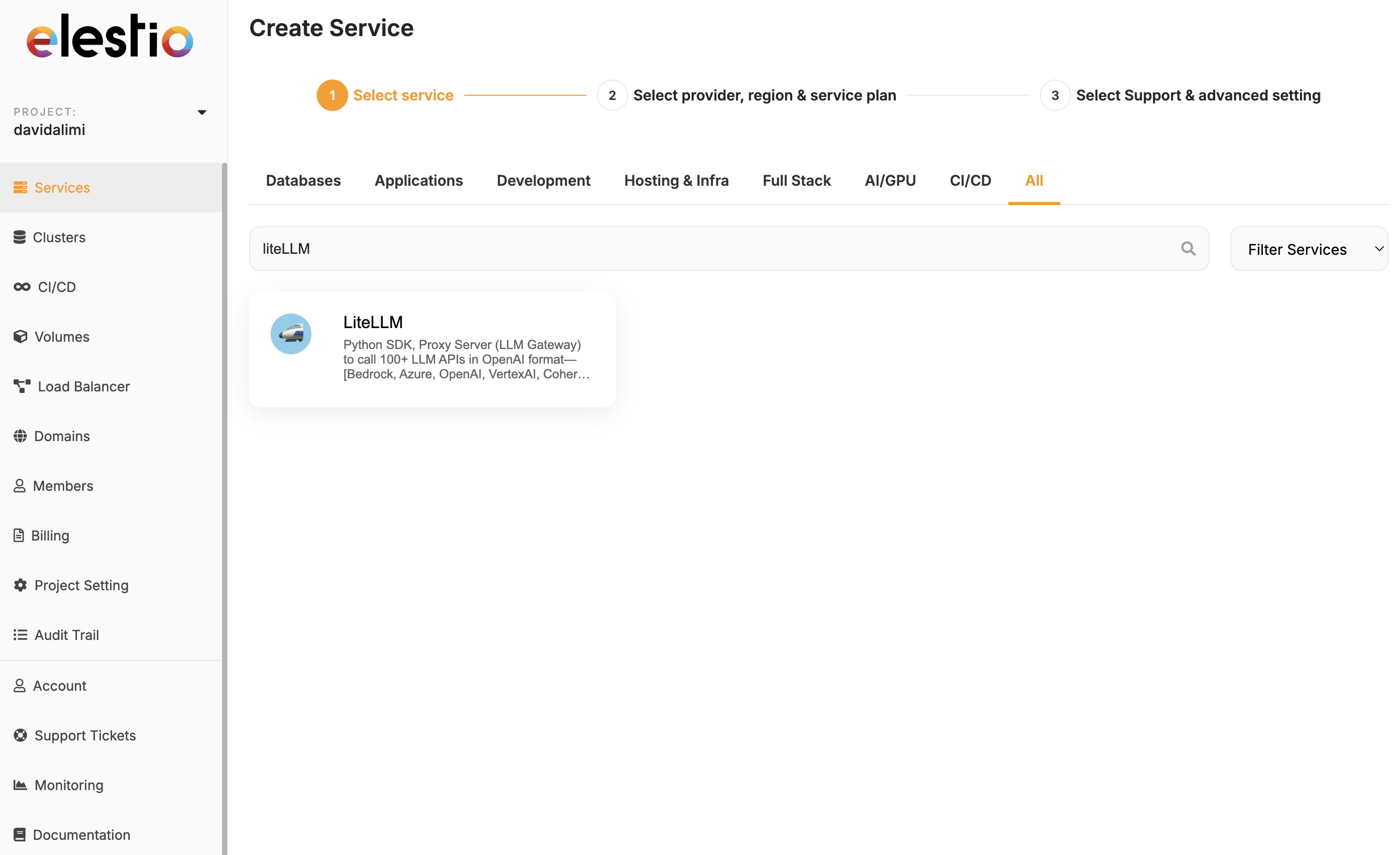

- Cherche "LiteLLM" dans le catalogue

- Choisis ton cloud provider et ta région

- Lance le déploiement

En quelques minutes, t'as une URL du type https://ton-litellm-xxx.vm.elestio.app avec le dashboard LiteLLM accessible sur /ui.

Première vérification

curl https://ton-litellm-xxx.vm.elestio.app/health/liveliness

# {"status": "healthy"}

Si ça répond, ton proxy tourne. Le dashboard admin est accessible sur https://ton-litellm-xxx.vm.elestio.app/ui.

Dans la prochaine leçon, on configure OpenRouter comme backend pour accéder à tous les modèles.